최신 포스트

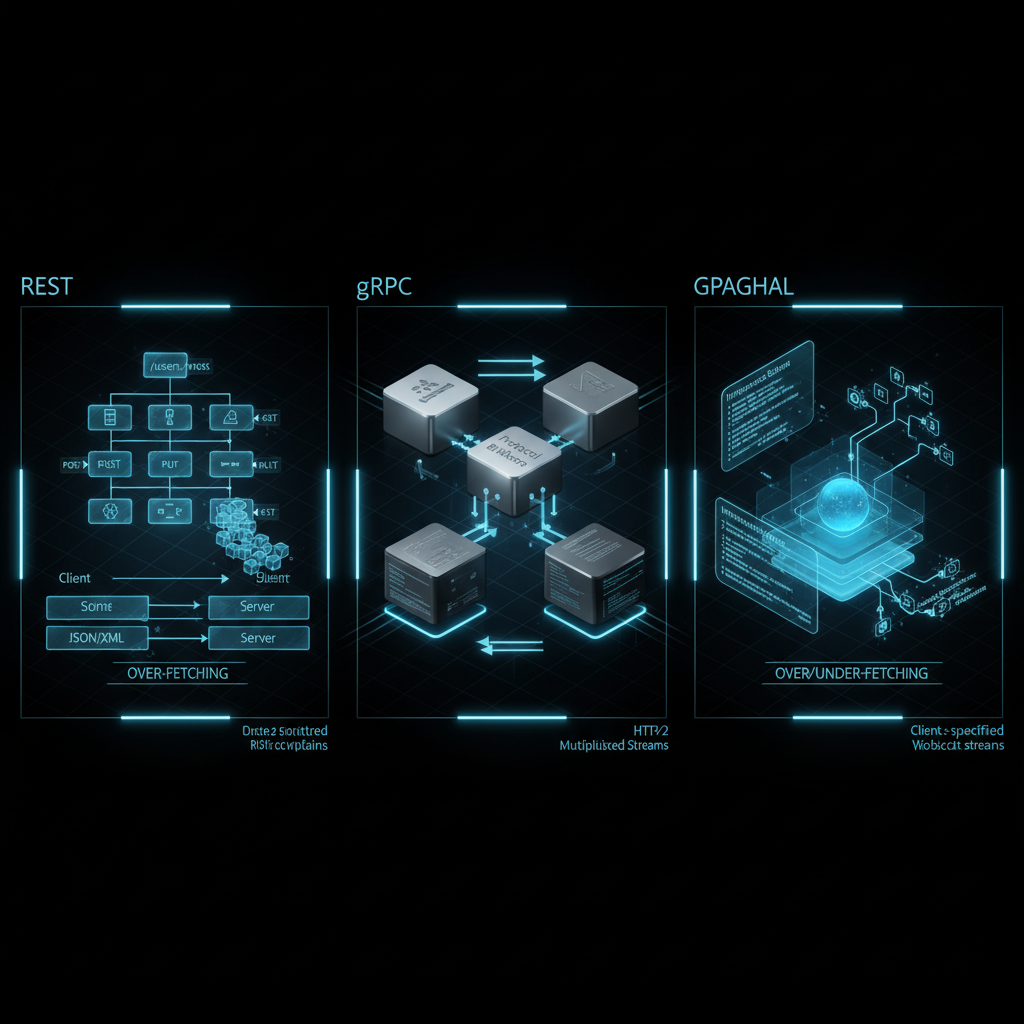

# gRPC vs REST vs GraphQL: 실무에서 API 선택하는 결정 프레임워크

API 설계는 기술 선택이 아닌 시스템 철학의 구현이다. REST, gRPC, GraphQL은 각기 다른 통신 패러다임을 대변하며, 선택의 핵심은 '무엇이 더 나은가'가 아닌 '어떤 문제를 해결하려 하는가'에 있다. 본 글은 세 가지 API 아키텍처의 본질적 차이를 구조적으로 분석하고, 실무 맥락에서 합리적 선택을 위한 사유의 틀을 제시한다.

8 views

# DevOps에서 Platform Engineering으로의 진화: 조직 규모별 실전 가이드

** DevOps는 문화적 이상이었으나, 현실의 조직은 인지 부하와 도구 복잡성 속에서 한계를 드러냈다. Platform Engineering은 이 간극을 메우는 구조적 해법이다. 본질은 Self-Service와 추상화를 통한 개발자 경험의 재설계에 있으며, 조직 규모에 따라 그 구현 방식은 달라져야 한다.

# 규제는 설계의 문제다: EU AI Act 이후의 전략적 재편

EU AI Act는 단순한 법규가 아니라 AI 시스템의 설계 원칙을 재정의하는 구조적 전환이다. 글로벌 기업들은 규제를 회피 대상이 아닌 설계 제약으로 받아들이며, 컴플라이언스를 경쟁력의 원천으로 전환하고 있다. 이는 기술의 본질이 '무엇을 할 수 있는가'에서 '어떻게 해야 하는가'로 이동하는 패러다임의 변화를 의미한다.

# 제로 트러스트 아키텍처, 2026년 한국 기업의 현장 도입 전략과 과제

경계 기반 보안의 붕괴는 더 이상 가정이 아닌 현실이다. 제로 트러스트는 이념이 아니라 구조적 재설계의 문제이며, 2026년 한국 기업은 레거시 인프라와 조직 문화라는 이중의 제약 속에서 이 전환을 수행해야 한다. 본질은 '신뢰하지 않는 것'이 아니라 '검증 가능한 신뢰 체계를 구축하는 것'에 있다.

# 원격 근무 3년, 생산성의 재정의

원격 근무는 단순히 장소의 이동이 아니라, 일하는 방식 자체의 재설계를 요구한다. 3년간의 실천을 통해 발견한 것은 생산성이 시간의 투입량이 아니라 주의력의 질서에서 비롯된다는 사실이다. 이 글은 원격 근무 환경에서 생산성을 구조적으로 재구축한 과정과 그 본질적 원리를 다룬다.

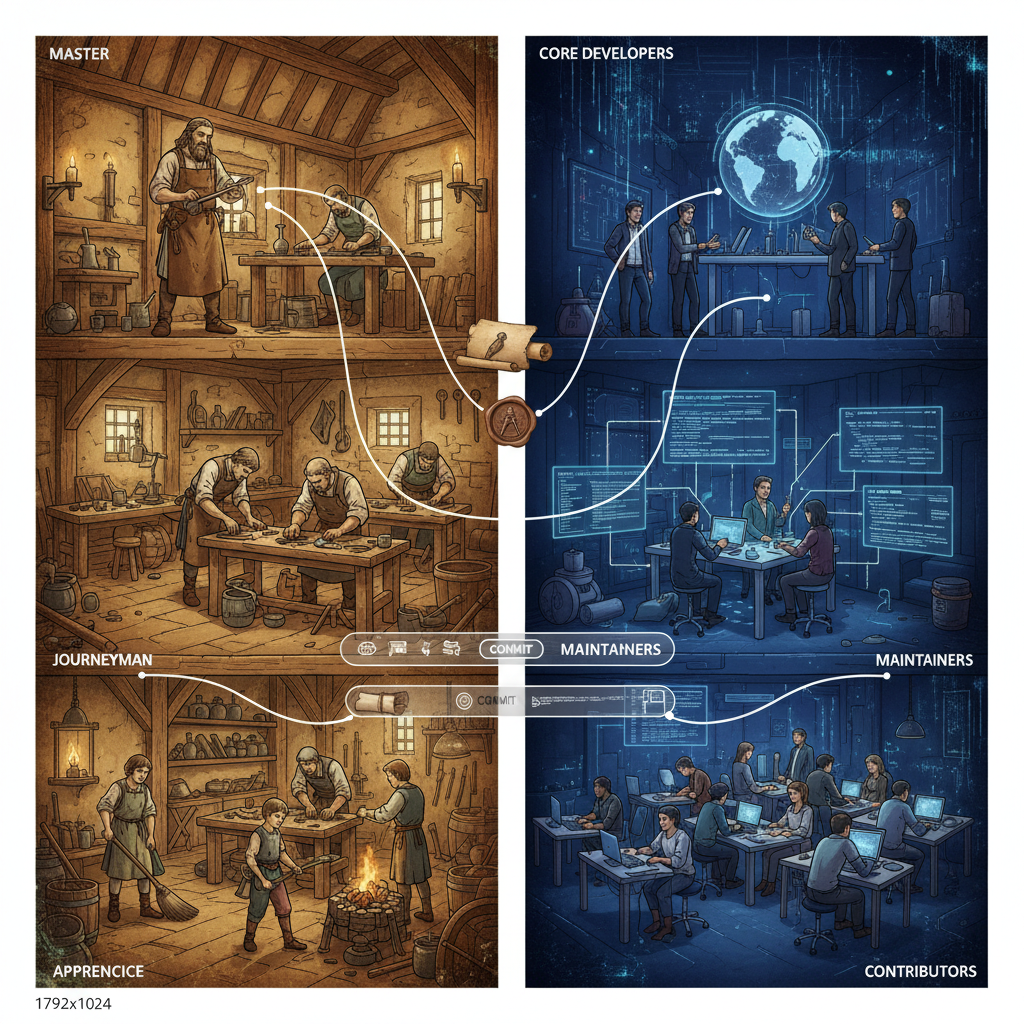

# 길드에서 깃허브까지: 지식 전승 구조의 천 년 진화

중세 유럽 길드는 단순한 직업 조합이 아니라, 지식을 통제하고 전승하는 제도적 설계였다. 도제-장인-마스터로 이어지는 위계, 비밀 유지를 통한 기술 독점, 품질 검증 시스템은 오늘날 오픈소스 커뮤니티의 기여자-메인테이너-코어 개발자 구조, 투명성 원칙, 코드 리뷰 문화와 대척점에 서 있으면서도 놀라울 만큼 유사한 패턴을 보인다. 이 글은 폐쇄와 개방이라는 상반된 철학 속에서도 관통하는 지식 전승의 본질적 구조를 탐구한다.

# 언어가 사유를 규정하는 방식: 프로그래밍 패러다임과 개발자의 인지 구조

프로그래밍 언어는 단순한 도구가 아니라 사고의 틀이다. 절차적, 객체지향적, 함수형 언어는 각각 다른 방식으로 문제를 분해하고 해결책을 구성하도록 개발자의 인지 구조를 형성한다. 언어의 선택은 곧 사유 방식의 선택이며, 이는 개발자가 세계를 인식하고 질서를 부여하는 근본적인 방법론을 결정한다.

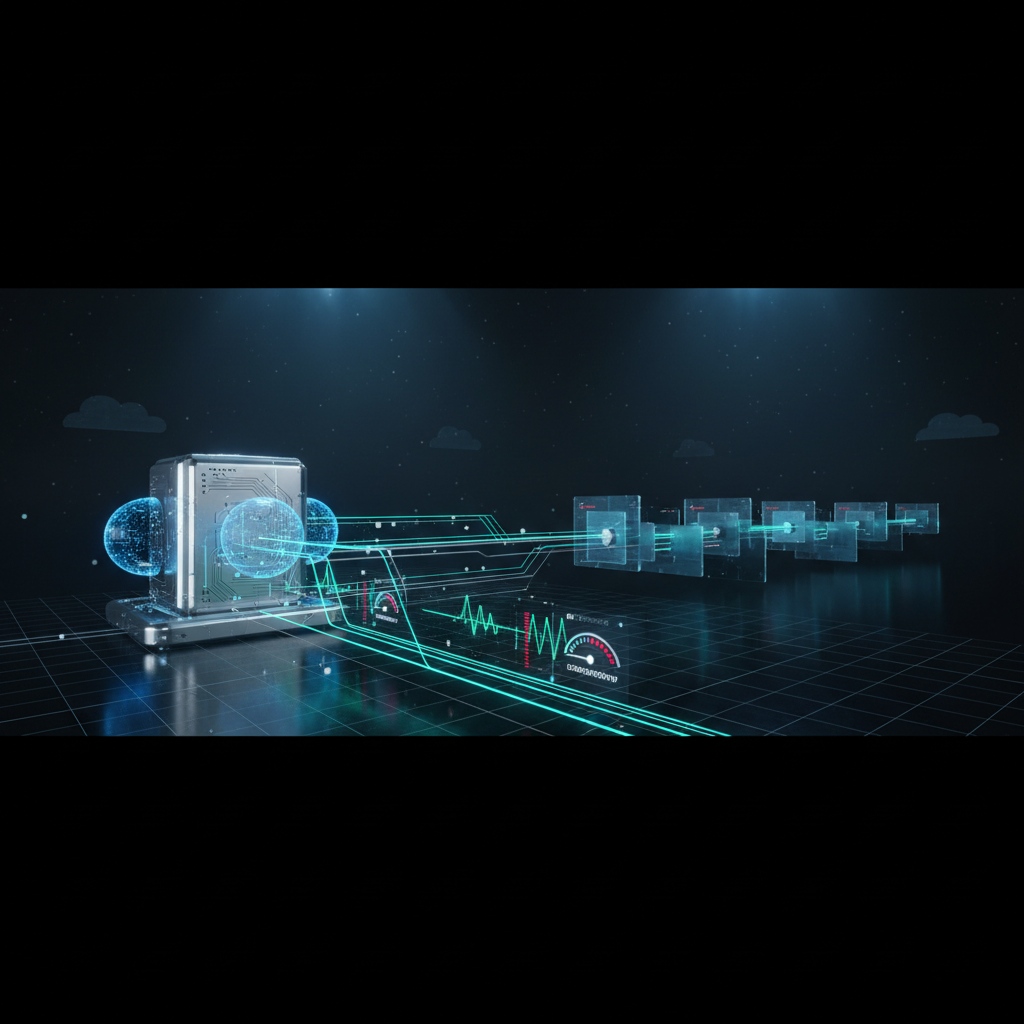

# 최소 자원으로 에이전트·로우코드 운영하는 AI 네이티브 개발 실전 설계 가이드

** AI 네이티브 개발의 핵심은 기술 스택의 화려함이 아닌, 제약 속에서 본질을 구현하는 설계 철학이다. 에이전트와 로우코드 패러다임은 최소 자원으로 최대 가치를 창출하는 구조적 전환을 요구한다. 본 글은 실전 설계의 원칙과 구현 전략을 논리적으로 탐구한다.

# 모든 길은 로마로 통한다: 제국의 도로망이 설계한 현대 물류의 원형

로마 제국의 도로망은 단순한 교통 인프라가 아니라, 중앙집권적 통치를 위한 시스템 설계였다. 8만 킬로미터에 달하는 도로는 군사·행정·경제를 하나의 네트워크로 연결했으며, 표준화·허브 중심 구조·물리적 내구성이라는 원칙은 현대 물류와 교통 시스템의 근본 설계 원리로 계승되었다. 과거의 돌길이 오늘날 디지털 네트워크의 논리를 예견했다는 사실은, 인프라가 곧 권력이자 문명의 골격임을 증명한다.