AI 시대 백엔드 협업 문화: 속도보다 먼저 바뀌는 합의의 방식

9 views

# AI 시대 백엔드 개발팀 협업과 문화 변화

AI가 들어오면서 백엔드 팀의 협업은 ‘속도’가 아니라 ‘합의의 방식’부터 바뀌었다.

PR이 빨리 올라오고, 리뷰도 빨리 돈다.

그런데 회의는 줄지 않는다. 장애 대응은 더 조용해지지 않는다.

속도가 늘어난 자리에는, 합의의 공백이 생기기 쉽다.

## 1) 현상: 코드가 빨라질수록, 팀은 더 자주 흔들린다

회의실에서 자주 보는 장면이 있다.

티켓은 얇고, PR은 두껍다.

설계는 비어 있는데 구현이 먼저 나온다.

“일단 돌아가게 만들었다”는 말이, 이전보다 쉽게 통과한다.

이 현상 자체는 자연스럽다.

AI는 구현의 마찰을 낮춘다.

문제는 구현의 마찰이 줄어든 만큼, 합의의 마찰도 같이 줄어든다는 점이다.

예전에는 “이걸 지금 구현하기 어렵다”가 합의를 강제했다. 이제는 그 장치가 약해졌다.

리뷰에서도 비슷한 일이 생긴다.

코드가 그럴듯해 보이면, 반박 비용이 올라간다.

반박하려면 근거가 필요하고, 근거를 만들려면 맥락을 복원해야 한다.

팀이 바쁜 상태일수록 “그럴듯함”은 승인 쪽으로 기운다.

여기서 문화가 바뀐다.

친절해지거나 냉정해지는 문제가 아니다.

**책임을 합의하는 방식이, 구현 속도를 따라가지 못하는 구조적 문제**다.

> AI는 코드를 잘 쓰는 도구가 아니라, 팀의 빈틈을 증폭시키는 장치에 가깝다.

> 빈틈이 크면, 생산성으로 보이는 비용이 운영에서 청구된다.

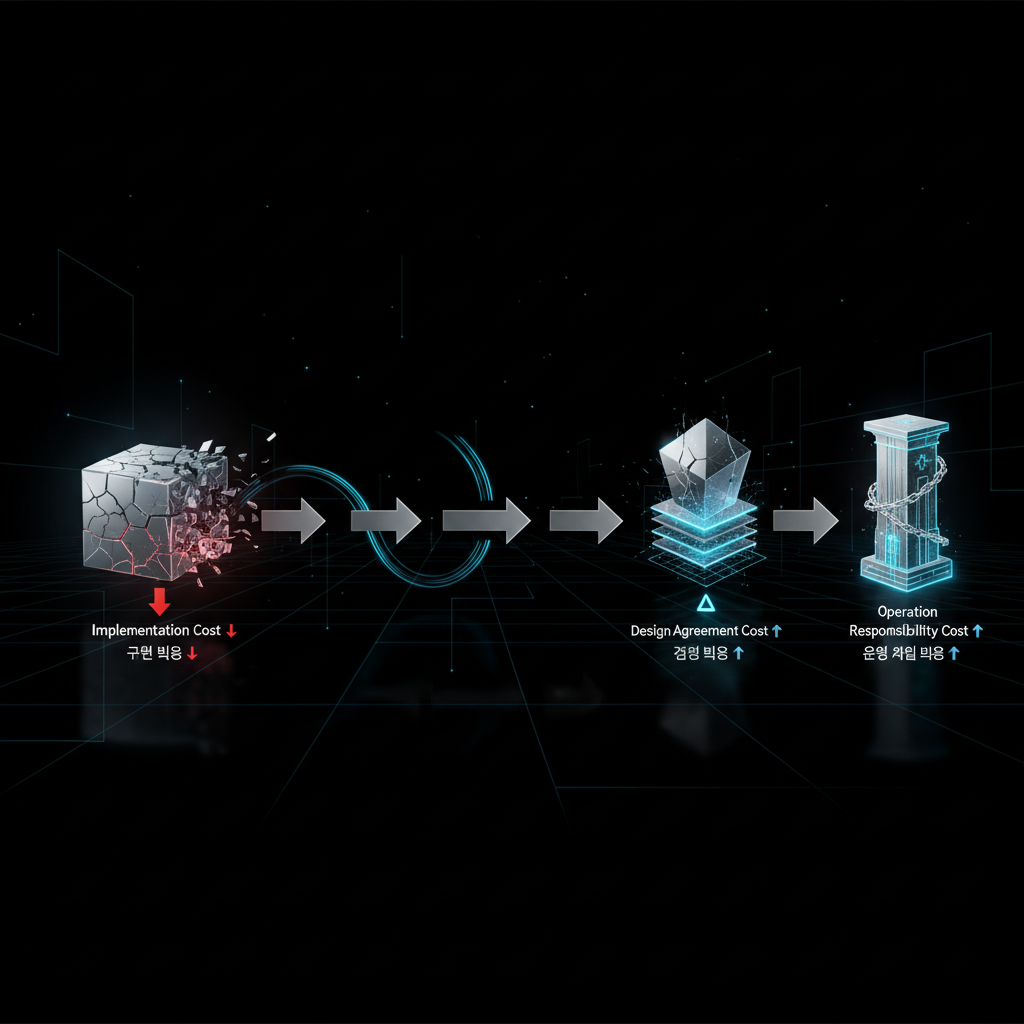

## 2) 구조: 협업 비용은 사라지지 않고, 이동한다 (속도 → 품질 → 책임)

AI 도입을 ‘생산성 증가’로만 설명하면 절반만 맞다.

정확히는 협업 비용의 재배치다.

구현 비용이 내려가면, 팀은 보통 세 곳에서 비용을 더 쓰게 된다.

### (1) 설계 합의 비용이 올라간다

구현이 쉬워지면, 설계의 필요성이 줄어드는 듯 보인다.

실제로는 반대다. 설계가 없을수록 구현이 폭증한다.

폭증한 구현은 나중에 한꺼번에 정리해야 한다. 그때 드는 비용이 설계 비용을 넘어선다.

특히 백엔드는 경계가 중요하다.

도메인 경계, 트랜잭션 경계, 데이터 일관성의 경계가 흐려지면, 코드는 늘고 시스템은 약해진다.

AI는 경계를 모른 채 “작동하는 코드”를 더 빨리 만든다.

팀의 합의가 경계를 정의하지 않으면, 경계는 자연발생하지 않는다.

### (2) 검증 비용이 올라간다

AI가 만든 코드는 종종 컴파일되고, 테스트도 일부 통과한다.

그러나 그게 의도를 보장하지는 않는다.

백엔드에서 진짜 비용은 예외 케이스와 동시성, 그리고 운영 조건에서 터진다.

리뷰가 빨라진 대신, 무엇이 줄었는지 봐야 한다.

대개는 “의도 확인”이 줄고 “표면적 오류 찾기”만 남는다.

이때 팀은 **리뷰를 정답 찾기에서 의도 검증으로 옮기지 않으면** 속도에 잠식된다.

### (3) 운영 책임 비용이 올라간다

운영은 늘 마지막에 진실을 말한다.

OOM, 쿼리 플랜, 인덱스 누락, 커넥션 풀 고갈 같은 문제는

코드가 그럴듯하다고 해서 사라지지 않는다.

AI는 운영을 대신하지 않는다.

운영은 합의의 총합이다.

“누가 확인했는가”, “어떤 기준으로 통과시켰는가”, “롤백이 가능한가”가 쌓여서 시스템이 된다.

결국 흐름은 단순하다.

속도를 얻으면, 품질을 설계해야 한다.

품질을 설계하면, 책임을 문서로 묶어야 한다.

이 순서를 건너뛰면, 팀 문화는 감정이 아니라 사고로 무너진다.

## 3) 협업 지점 5곳에서 벌어지는 변화: 돕는 것 / 망치는 것 / 새 합의

백엔드 팀의 협업은 대체로 다섯 지점에서 일어난다.

요구사항, 설계, 구현, 검증, 운영.

AI는 각 지점에서 다른 방식으로 팀을 도와주고, 동시에 다른 방식으로 팀을 속인다.

### 3.1 요구사항 해석(티켓/스펙)

AI가 돕는 것:

요구사항을 문장으로 정리하고, 누락된 질문을 뽑아내는 일은 빨라진다.

특히 “이 요청이 API 계약에 어떤 영향을 주는가” 같은 체크리스트화가 쉬워진다.

AI가 망치는 것:

스펙이 빈약할수록, AI는 더 그럴듯한 가정을 채워 넣는다.

그 가정은 코드로 고정되고, 나중에 “왜 이렇게 했지?”로 돌아온다.

요구사항의 공백이 구현의 확신으로 변하는 순간이 위험하다.

팀이 새로 합의해야 하는 것:

티켓의 최소 요건을 정해야 한다.

예컨대 “정의(Definition) / 비정의(Non-goal) / 실패 조건 / 관측 지표” 정도는 짧게라도 남긴다.

이 합의가 없으면, 팀은 매번 회의에서 같은 공백을 다시 메운다.

### 3.2 설계(도메인 경계, DB 스키마, API 계약)

AI가 돕는 것:

초안 작성은 빠르다. ERD 후보, API 스펙 후보, 마이그레이션 초안이 금방 나온다.

회의의 출발점을 만드는 데는 유용하다.

AI가 망치는 것:

초안이 회의의 결론으로 오해되기 쉽다.

특히 레이어 구조나 Repository Pattern 같은 관습적 형태는, 그럴듯하게 과잉 생산된다.

그 결과 “경계가 왜 이렇게 생겼는지”가 사라지고, 형태만 남는다.

팀이 새로 합의해야 하는 것:

설계에서 합의해야 할 대상은 산출물이 아니라 **의도**다.

API는 어떤 변경을 허용하고, 어떤 변경을 금지하는가.

DB 스키마는 어떤 조회 패턴을 전제로 하는가.

트랜잭션은 어디까지가 원자성의 단위인가.

이 질문에 답이 없으면, 설계 문서는 장식이 된다.

### 3.3 구현(코드 생성/리팩토링)

AI가 돕는 것:

보일러플레이트, 반복되는 매핑, 단순 CRUD는 확실히 빨라진다.

리팩토링의 첫 단계, 즉 “형태를 바꾸는 작업”도 속도가 난다.

AI가 망치는 것:

형태가 바뀌면 의미가 바뀐다는 사실이 종종 잊힌다.

특히 예외 처리, 경계값, 트랜잭션 전파, 락의 범위는 “형태”가 아니라 “의도”다.

AI가 만든 리팩토링이 기능을 유지하는지 확인하려면, 테스트가 전제되어야 한다.

팀이 새로 합의해야 하는 것:

AI 사용의 범위를 문서로 정해야 한다.

예를 들어 “새 기능의 핵심 로직은 사람이 먼저 설계하고, AI는 반복 코드에 한정한다” 같은 규칙이다.

핵심은 사용 여부가 아니라 책임의 귀속이다.

### 3.4 검증(테스트, 코드리뷰, 보안 점검)

AI가 돕는 것:

테스트 케이스 목록을 뽑고, 기본적인 단위 테스트 뼈대를 만드는 일은 빨라진다.

리뷰에서 지적할 만한 스타일 문제도 빠르게 찾는다.

AI가 망치는 것:

테스트가 “있다”는 사실이 “검증됐다”로 둔갑한다.

또한 보안 점검은 체크리스트를 통과했다고 안전해지지 않는다.

특히 인증/인가, 입력 검증, 로그 마스킹 같은 영역은 시스템 맥락이 핵심이다.

팀이 새로 합의해야 하는 것:

리뷰의 중심 질문을 바꿔야 한다.

“이 코드가 맞나?”보다 “이 코드가 **우리 시스템의 의도**를 따르나?”가 앞에 와야 한다.

그리고 PR에 의도와 검증 방법이 적히지 않으면, 리뷰는 표류한다.

### 3.5 운영(장애 대응, 모니터링, 회고)

AI가 돕는 것:

로그를 요약하고, 가능한 원인을 넓게 제시하는 데는 도움이 된다.

문서화, 회고 정리도 빨라진다.

AI가 망치는 것:

운영 이슈는 그럴듯한 답이 가장 위험하다.

예를 들어 쿼리 느림의 원인은 인덱스일 수도, 통계일 수도, 락일 수도 있다.

AI의 제안은 가설일 뿐이며, 확인은 사람이 해야 한다.

팀이 새로 합의해야 하는 것:

장애 대응에서 필요한 것은 지식이 아니라 절차다.

누가 타임라인을 기록하는지, 누가 롤백을 결정하는지, 어떤 지표를 보고 종료를 선언하는지.

AI를 끼워 넣을수록, 이 절차를 더 엄격히 해야 한다.

## 4) 코드리뷰의 중심 이동: 정답 찾기에서 의도 검증으로

AI 이후의 코드리뷰는 속도가 아니라 성격이 바뀐다.

예전에는 “문법, 스타일, 누락된 예외” 같은 정답형 질문이 비중이 컸다.

이제는 그 부분이 자동화되거나 축소된다. 대신 더 어려운 질문이 남는다.

첫째, 이 변경이 시스템의 약속을 깨지 않는가.

API 계약, 도메인 규칙, 데이터 일관성, 성능 예산 같은 약속은 코드만 보고는 보이지 않는다.

리뷰는 코드를 넘어 약속을 확인해야 한다.

둘째, 레이어 침범이 일어나지 않는가.

AI는 레이어를 “자연스럽게” 섞는다.

편하니까 섞고, 돌아가니까 통과한다.

하지만 그 편의는 장기적으로 경계를 무너뜨린다. 경계가 무너지면 수정 비용이 폭발한다.

셋째, 리뷰의 책임 소재가 흐려지지 않는가.

리뷰가 빨라질수록 “누가 최종 책임자인가”가 희미해진다.

승인은 버튼이지만, 책임은 운영에서 회수된다.

팀은 승인 행위에 의미를 다시 부여해야 한다.

나는 리뷰를 이렇게 정의한다.

리뷰는 코드 품질 검사라기보다, 팀의 합의가 코드로 잘 번역되었는지 확인하는 절차다.

번역의 기준이 없으면, 번역은 취향 싸움이 된다.

## 5) 내가 바꾼 규칙 3가지: AI 사용을 ‘문화’가 아니라 ‘절차’로 묶기

AI 사용을 권장하느냐 금지하느냐는 본질이 아니다.

팀이 지속적으로 운영 가능한 형태로 책임을 묶는지가 본질이다.

나는 다음 세 가지를 규칙으로 고정했다. 완벽한 답이라기보다, 비용을 치른 뒤 남긴 형태다.

### 규칙 1) PR 템플릿에 “의도/대안/테스트/롤백”을 강제했다

PR 설명이 비어 있으면 리뷰가 표류한다.

AI가 코드를 잘 쓰는 만큼, 설명 없이도 PR이 그럴듯해 보이기 때문이다.

그래서 PR 템플릿에 네 줄을 고정했다.

- 의도: 이 변경이 해결하는 문제

- 대안: 고려했으나 버린 선택지

- 테스트: 무엇으로 검증했는가(단위/통합/부하 등)

- 롤백: 되돌리는 방법과 영향 범위

이 네 줄이 있으면, 리뷰는 “정답” 대신 “의도”를 다룬다.

또한 장애 대응에서 “누가 무엇을 알고 있었나”가 기록으로 남는다.

### 규칙 2) AI가 만든 코드일수록 테스트를 더 요구했다 (특히 경계/트랜잭션/동시성)

AI 생성 코드는 평균적으로 빠르다.

하지만 평균은 운영에서 의미가 약하다. 운영은 꼬리에서 터진다.

그래서 테스트 요구를 영역별로 명시했다.

- 경계값: 빈 값, 최대 길이, 오버플로우, 시간대

- 트랜잭션: 커밋/롤백 조건, 격리 수준의 가정

- 동시성: 중복 요청, 재시도, 멱등성, 락 범위

이 규칙은 팀을 느리게 만들기 위한 것이 아니다.

속도를 운영으로 돌려막지 않기 위한 장치다.

### 규칙 3) DB 변경은 “마이그레이션 + 검증 쿼리 + 롤백”을 세트로 묶었다

백엔드에서 가장 비싼 변경은 DB에서 일어난다.

AI는 스키마 변경 스크립트를 그럴듯하게 만든다.

하지만 인덱스, 제약, 데이터 분포, 쿼리 플랜은 환경을 타며, 확인이 필요하다.

그래서 DB 변경은 세 가지가 없으면 병합하지 않기로 했다.

- 마이그레이션 스크립트(정방향)

- 검증 쿼리(적용 후 데이터/성능 확인)

- 롤백 스크립트 또는 롤백 절차(역방향)

이 세트는 단순한 형식이 아니다.

운영 책임을 코드에 묶는 방식이다.

AI가 개입할수록, 이 묶음은 더 의미가 커진다.

## 6) 함의: 문화는 친절이 아니라 책임 경계를 명확히 하는 기술이다

AI가 팀에 가져오는 변화는 인간관계의 변화가 아니다.

협업의 물리학이 바뀌는 것이다.

구현이 쉬워지면, 합의가 어려워진다.

합의가 어려워지면, 책임이 필요해진다.

2026년의 팀 문화는 보통 여기서 갈린다.

AI를 쓰는 팀과 안 쓰는 팀이 아니다.

AI 사용 규칙을 문서로 고정한 팀과, 구두 합의로 버티는 팀이다.

문서화는 관료주의가 아니다.

기억 비용을 줄이는 기술이다.

리뷰가 빨라질수록, 회고가 짧아질수록, 기억은 더 빨리 왜곡된다.

팀은 왜곡을 절차로 막아야 한다.

그리고 한 가지를 인정해야 한다.

선택은 언제나 포기를 동반한다.

AI로 얻은 시간은 결국 검증과 운영 책임으로 되돌려 써야 한다.

그 시간을 어디에 쓸지 합의하지 않으면, 시간은 사라지고 부채만 남는다.

## 결론: AI가 바꾸는 것은 코드가 아니라, 책임을 합의하는 방식이다

AI는 백엔드 팀의 속도를 올리지만, 그 속도는 곧바로 품질과 책임의 문제로 환전된다.

팀 문화는 감정의 문제가 아니라, 합의를 반복 가능하게 만드는 구조의 문제다.

**AI가 바꾸는 것은 코드가 아니라, 책임을 합의하는 방식이다.**